Cet article illustrera le processus de création d'applications LangChain à l'aide d'un modèle d'invite et d'un analyseur de sortie.

Comment créer des applications LangChain à l'aide d'un modèle d'invite et d'un analyseur de sortie ?

Pour créer l'application LangChain à l'aide du modèle d'invite et de l'analyseur de sortie, parcourez simplement ce guide simple :

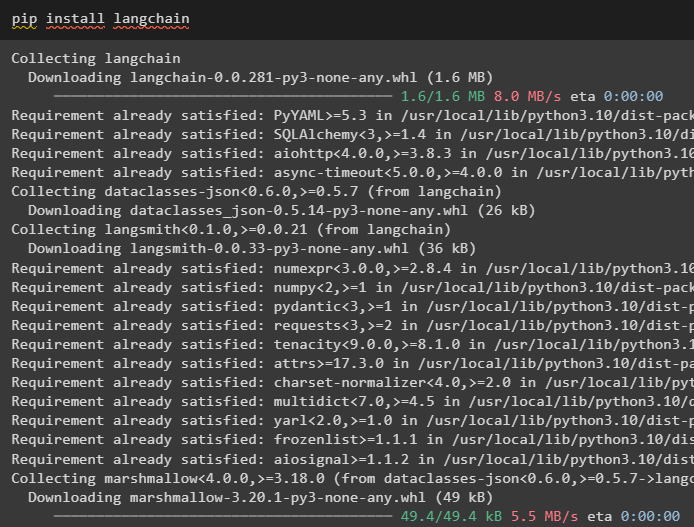

Étape 1 : Installer LangChain

Tout d’abord, démarrez le processus de création d’applications LangChain en installant le framework LangChain à l’aide du « pépin ' commande:

pip installer langchain

Étape 2 : Utilisation d'un modèle d'invite

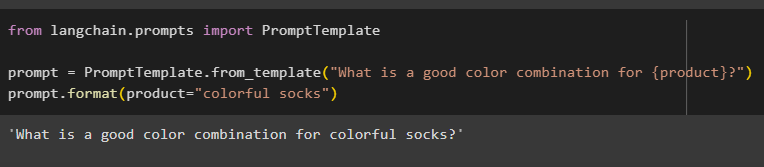

Après avoir installé les modules LangChain, importez le « Modèle d'invite ' pour créer un modèle d'invite en fournissant une requête au modèle pour comprendre la question :

à partir de langchain.prompts, importez PromptTemplate

prompt = PromptTemplate.from_template('Quelle est une bonne combinaison de couleurs pour {produit} ?')

prompt.format(product='chaussettes colorées')

La sortie combinait automatiquement la phrase avec la valeur de « produit 'variable :

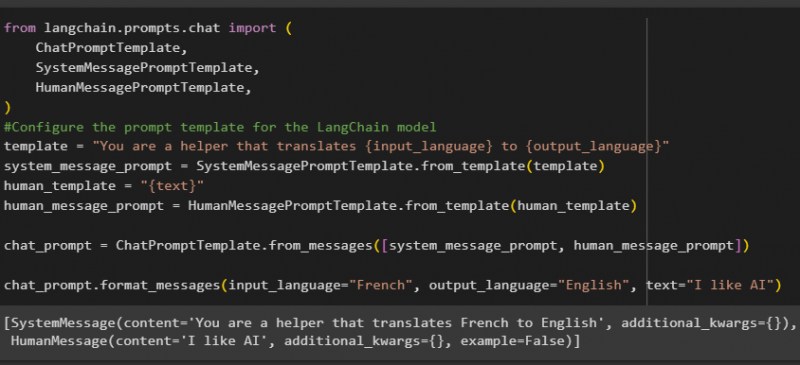

Après cela, créez un autre modèle d'invite en important les bibliothèques HumanMessagePromptTemplate, ChatPromptTemplate et SystemMessagePromptTemplate à partir de LangChain :

à partir de l'importation langchain.prompts.chat (Modèle d'invite de chat,

Modèle d'invite de message système,

Modèle d'invite de message humain,

)

#Configurer le modèle d'invite pour le modèle LangChain

template = 'Vous êtes un assistant qui traduit {input_langage} en {output_langage}'

system_message_prompt = SystemMessagePromptTemplate.from_template(template)

human_template = '{texte}'

human_message_prompt = HumanMessagePromptTemplate.from_template(human_template)

chat_prompt = ChatPromptTemplate.from_messages([system_message_prompt, human_message_prompt])

chat_prompt.format_messages(input_langue='Français', output_langue='Anglais', text='J'aime l'IA')

Après avoir importé toutes les bibliothèques requises, construisez simplement le modèle personnalisé pour les requêtes à l'aide de la variable de modèle :

Les modèles d'invite ne sont utilisés que pour définir le modèle de la requête/question et ne répondent pas à la question. Cependant, la fonction OutputParser() peut extraire des réponses comme l'explique la section suivante avec l'exemple :

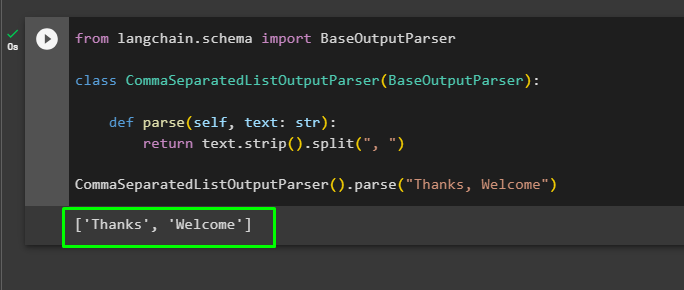

Étape 3 : Utilisation de l'analyseur de sortie

Maintenant, importez la bibliothèque BaseOutputParser depuis LangChain pour séparer les valeurs de texte séparées par des virgules et renvoyer la liste dans la sortie :

à partir de langchain.schema importer BaseOutputParserclasse CommaSeparatedListOutputParser (BaseOutputParser) :

def parse (soi, texte : str) :

retourner text.strip().split(', ')

CommaSeparatedListOutputParser().parse('Merci, bienvenue')

Il s’agit de créer l’application LangChain à l’aide du modèle d’invite et de l’analyseur de sortie.

Conclusion

Pour créer une application LangChain à l'aide du modèle d'invite et de l'analyseur de sortie, installez simplement LangChain et importez les bibliothèques à partir de celui-ci. La bibliothèque PromptTemplate est utilisée pour créer la structure de la requête afin que le modèle puisse comprendre la question avant d'extraire les informations à l'aide de la fonction Parser(). La fonction OutputParser() est utilisée pour récupérer des réponses basées sur les requêtes personnalisées précédemment. Ce guide a expliqué le processus de création d'applications LangChain à l'aide du modèle d'invite et de l'analyseur de sortie.