Cet article fournit un guide étape par étape sur l'utilisation des tokenizers dans Hugging Face Transformers.

Qu'est-ce qu'un Tokenizer ?

Tokenizer est un concept important de la PNL, et son objectif principal est de traduire le texte brut en chiffres. Il existe diverses techniques et méthodologies à cet effet. Cependant, il convient de noter que chaque technique répond à un objectif précis.

Comment utiliser les tokenizers dans les transformateurs Hugging Face ?

Comment utiliser les tokenizers dans les transformateurs Hugging Face ?

La bibliothèque tokenizer doit d'abord être installée avant de l'utiliser et d'en importer des fonctions. Après cela, entraînez un modèle à l'aide d'AutoTokenizer, puis fournissez les informations nécessaires pour effectuer la tokenisation.

Hugging Face présente trois grandes catégories de tokenisation qui sont indiquées ci-dessous :

- Tokenizer basé sur des mots

- Tokenizer basé sur les personnages

- Tokenizer basé sur des sous-mots

Voici un guide étape par étape pour utiliser les tokenizers dans Transformers :

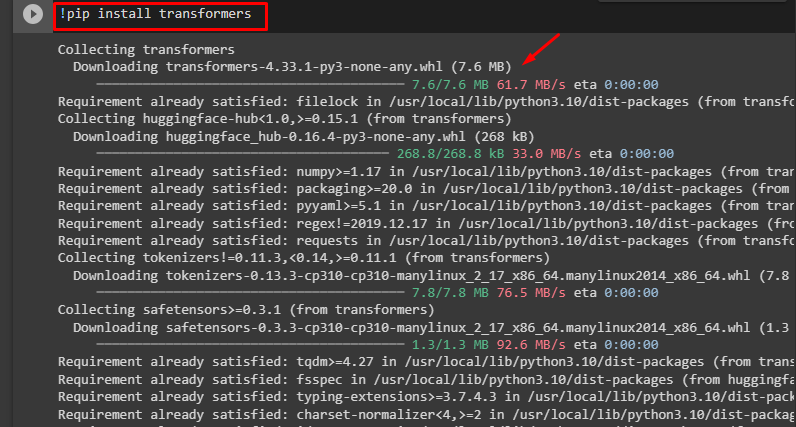

Étape 1 : Installer les transformateurs

Pour installer des transformateurs, utilisez la commande pip dans la commande suivante :

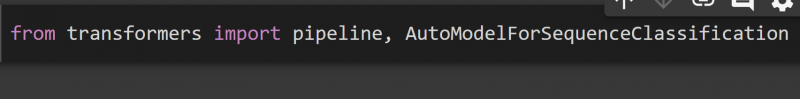

Étape 2 : Importer des classes

Depuis les transformateurs, importez pipeline , et AutoModelForSequenceClassification bibliothèque pour effectuer la classification :

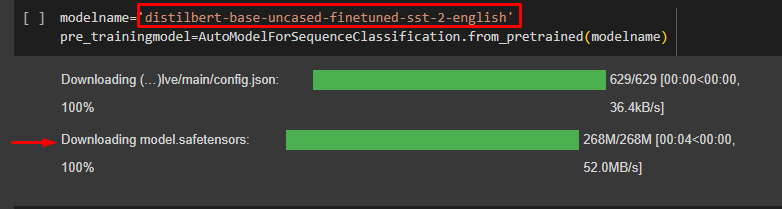

Étape 3 : Importer le modèle

Le ' AutoModelForSequenceClassification ' est une méthode qui appartient à Auto-Class pour la tokenisation. Le from_pretrained() La méthode est utilisée pour renvoyer la classe de modèle correcte en fonction du type de modèle.

Ici, nous avons fourni le nom du modèle dans le champ « nom du modèle 'variable :

nom du modèle = 'distilbert-base-uncased-finetuned-sst-2-anglais'modèle pré_entraînement =AutoModelForSequenceClassification.from_pretrained ( nom du modèle )

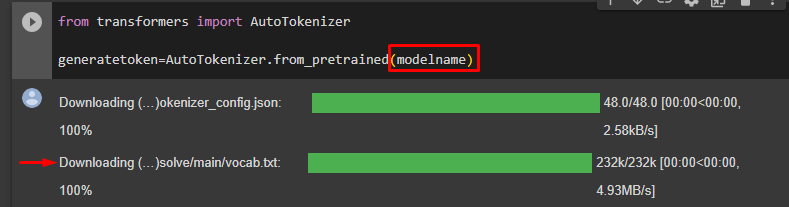

Étape 4 : Importer AutoTokenizer

Fournissez la commande suivante pour générer des jetons en passant le « nom du modèle » comme argument :

le jeton généré =AutoTokenizer.from_pretrained ( nom du modèle )

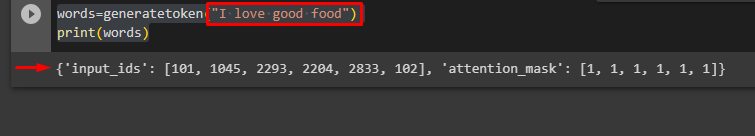

Étape 5 : Générer un jeton

Maintenant, nous allons générer des jetons sur une phrase «J'aime la bonne nourriture» en utilisant le ' le jeton généré 'variable :

imprimer ( mots )

Le résultat est donné comme suit :

Le code ci-dessus Google Co. est donné ici.

Conclusion

Pour utiliser les tokenizers dans Hugging Face, installez la bibliothèque à l'aide de la commande pip, entraînez un modèle à l'aide d'AutoTokenizer, puis fournissez l'entrée pour effectuer la tokenisation. En utilisant la tokenisation, attribuez des pondérations aux mots en fonction desquels ils sont séquencés pour conserver le sens de la phrase. Ce score détermine également leur valeur pour l’analyse. Cet article est un guide détaillé sur la façon d'utiliser les tokenizers dans Hugging Face Transformers.