Ce guide illustrera le processus de chargement des chaînes depuis LangChain Hub.

Comment ajouter un état de mémoire dans une chaîne à l'aide de LangChain ?

L'état de la mémoire peut être utilisé pour initialiser les chaînes car il peut faire référence à la valeur récente stockée dans les chaînes qui sera utilisée lors du renvoi de la sortie. Pour apprendre le processus d'ajout d'un état mémoire dans les chaînes à l'aide du framework LangChain, parcourez simplement ce guide simple :

Étape 1 : Installer les modules

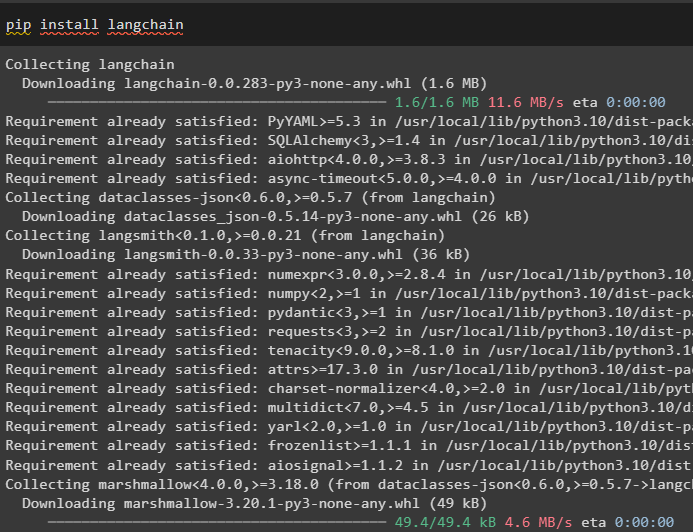

Tout d'abord, lancez-vous dans le processus en installant le framework LangChain avec ses dépendances à l'aide de la commande pip :

pip installer langchain

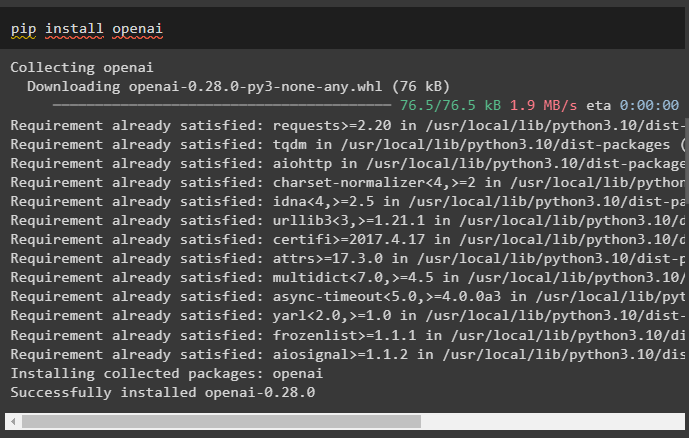

Installez également le module OpenAI pour obtenir ses bibliothèques qui peuvent être utilisées pour ajouter un état de mémoire dans la chaîne :

pip installer openai

Obtenez la clé API du compte OpenAI et mettre en place l'environnement l'utiliser pour que les chaînes puissent y accéder :

importer toi

importer obtenir un laissez-passer

toi . environ [ 'OPENAI_API_KEY' ] = obtenir un laissez-passer . obtenir un laissez-passer ( « Clé API OpenAI : » )

Cette étape est importante pour que le code fonctionne correctement.

Étape 2 : Importer des bibliothèques

Après avoir configuré l'environnement, importez simplement les bibliothèques pour ajouter l'état de la mémoire comme LLMChain, ConversationBufferMemory et bien d'autres :

depuis chaîne de langage. Chaînes importer Chaîne de conversationsdepuis chaîne de langage. mémoire importer ConversationBufferMémoire

depuis chaîne de langage. chat_models importer ChatOpenAI

depuis chaîne de langue. Chaînes . llm importer LLMChaîne

depuis chaîne de langage. instructions importer Modèle d'invite

Étape 3 : Construire des chaînes

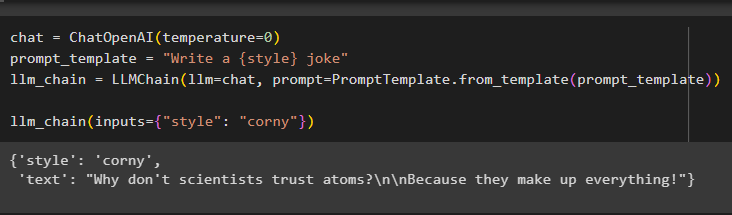

Maintenant, créez simplement des chaînes pour le LLM en utilisant la méthode OpenAI() et le modèle d'invite en utilisant la requête pour appeler la chaîne :

chat = ChatOpenAI ( température = 0 )invite_template = 'Écrivez une blague {style}'

llm_chain = LLMChaîne ( llm = chat , rapide = Modèle d'invite. à partir du modèle ( invite_template ) )

llm_chain ( contributions = { 'style' : 'éculé' } )

Le modèle a affiché la sortie à l'aide du modèle LLM comme indiqué dans la capture d'écran ci-dessous :

Étape 4 : ajout de l'état de la mémoire

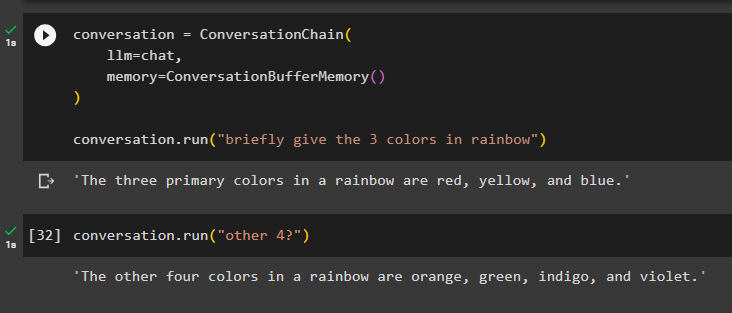

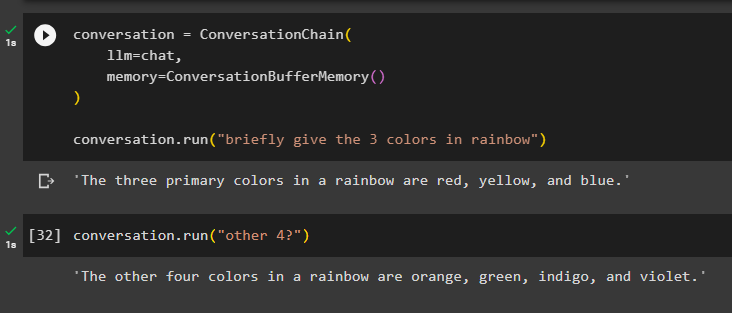

Ici, nous allons ajouter l'état de la mémoire dans la chaîne en utilisant la méthode ConversationBufferMemory() et exécuter la chaîne pour obtenir 3 couleurs de l'arc-en-ciel :

conversation = Chaîne de conversations (llm = chat ,

mémoire = ConversationBufferMémoire ( )

)

conversation. courir ( 'donnez brièvement les 3 couleurs de l'arc-en-ciel' )

Le modèle n'a affiché que trois couleurs de l'arc-en-ciel et le contexte est stocké dans la mémoire de la chaîne :

Ici, nous exécutons la chaîne avec une commande ambiguë comme « 4 autres ? » afin que le modèle lui-même récupère le contexte de la mémoire et affiche les couleurs arc-en-ciel restantes :

conversation. courir ( '4 autres ?' )C’est exactement ce que le modèle a fait, car il a compris le contexte et a renvoyé les quatre couleurs restantes de l’ensemble arc-en-ciel :

Il s’agit de charger des chaînes depuis LangChain Hub.

Conclusion

Pour ajouter de la mémoire dans des chaînes à l'aide du framework LangChain, installez simplement des modules pour configurer l'environnement de construction du LLM. Après cela, importez les bibliothèques nécessaires à la construction des chaînes dans le LLM, puis ajoutez-y l'état de la mémoire. Après avoir ajouté l'état de la mémoire à la chaîne, donnez simplement une commande à la chaîne pour obtenir le résultat, puis donnez une autre commande dans le contexte de la précédente pour obtenir la réponse correcte. Cet article a développé le processus d'ajout d'un état de mémoire dans les chaînes à l'aide du framework LangChain.