Ce guide illustrera le processus d'utilisation d'un tampon de résumé de conversation dans LangChain.

Comment utiliser un tampon de résumé de conversation dans LangChain ?

La conversation peut comprendre plusieurs messages qui s'apparentent à une interaction entre l'homme et la machine et le tampon peut stocker les messages les plus récents. Le ConversationRésuméBufferMémoire La bibliothèque est utilisée pour combiner les deux concepts comme stocker les messages les plus récents et extraire leur résumé.

Pour apprendre le processus d'utilisation du tampon de résumé de conversation dans LangChain, parcourez simplement le guide suivant :

Étape 1 : Installer les modules

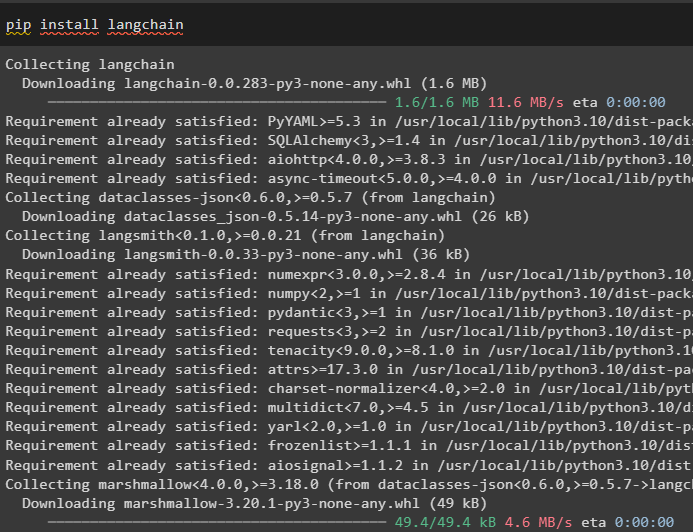

Tout d'abord, installez le module LangChain à l'aide de la commande pip pour obtenir les bibliothèques requises :

pip installer langchain

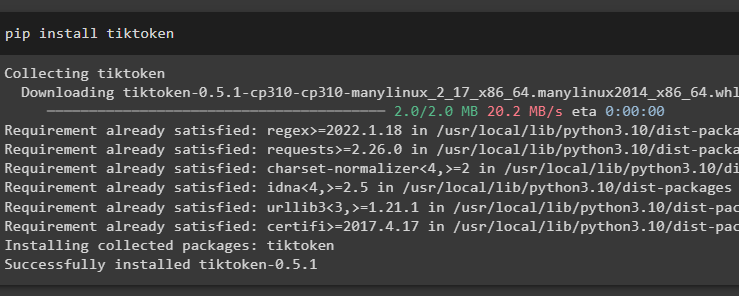

Installez le tokenizer tiktoken qui peut être utilisé pour diviser les documents texte en petits morceaux :

pip installer tiktoken

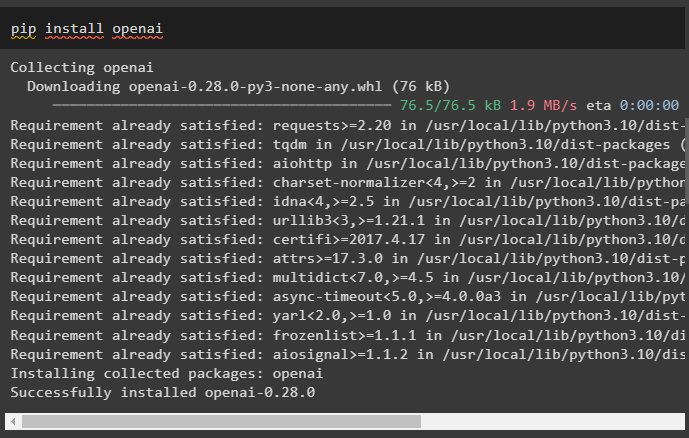

Après cela, installez les modules OpenAI qui peuvent être utilisés pour créer les modèles de langage tels que les LLM et les chaînes :

pip installer openai

Maintenant, mettre en place l'environnement en récupérant la clé API du compte OpenAI et en l'utilisant dans le modèle :

importer toiimporter obtenir un laissez-passer

toi . environ [ 'OPENAI_API_KEY' ] = obtenir un laissez-passer . obtenir un laissez-passer ( « Clé API OpenAI : » )

Étape 2 : Utilisation du tampon de résumé de conversation

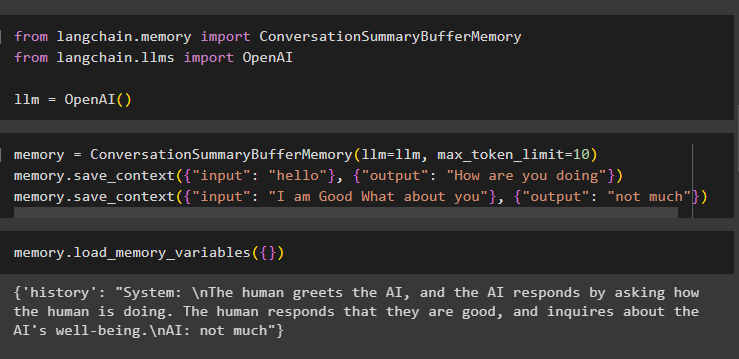

Démarrez le processus d'utilisation du tampon de résumé de conversation en important les bibliothèques pour créer le LLM à l'aide de la méthode OpenAI() :

depuis chaîne de langue. mémoire importer ConversationRésuméBufferMémoiredepuis chaîne de langue. llms importer OpenAI

llm = OpenAI ( )

Construisez la mémoire à l'aide de la méthode ConversationSummaryBufferMemory(), puis stockez la conversation dans la mémoire :

mémoire = ConversationRésuméBufferMémoire ( llm = llm , max_token_limit = dix )mémoire. sauvegarder_contexte ( { 'saisir' : 'Bonjour' } , { 'sortir' : 'Comment allez-vous' } )

mémoire. sauvegarder_contexte ( { 'saisir' : 'Je suis bon et toi' } , { 'sortir' : 'pas beaucoup' } )

Maintenant, exécutez la mémoire en appelant le load_memory_variables () méthode pour extraire les messages de la mémoire :

mémoire. load_memory_variables ( { } )

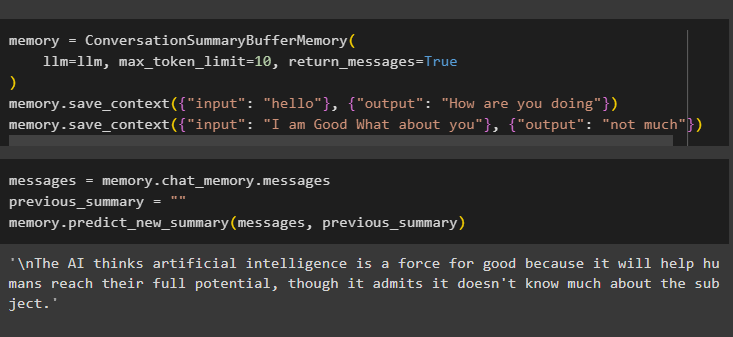

Maintenant, utilisez le résumé du tampon de la conversation pour configurer le tampon en limitant le nombre de messages à stocker dans le tampon. Après cela, extrayez le résumé de ces messages stocké dans le tampon puis stockez la conversation en mémoire :

mémoire = ConversationRésuméBufferMémoire (llm = llm , max_token_limit = dix , return_messages = Vrai

)

mémoire. sauvegarder_contexte ( { 'saisir' : 'Bonjour' } , { 'sortir' : 'Comment allez-vous' } )

mémoire. sauvegarder_contexte ( { 'saisir' : 'Je suis bon et toi' } , { 'sortir' : 'pas beaucoup' } )

Récupérez le résumé des messages précédents stockés dans la mémoire tampon à l'aide du code suivant :

messages = mémoire. chat_mémoire . messagesrésumé_précédent = ''

mémoire. prédire_nouveau_summary ( messages , résumé_précédent )

Étape 3 : Utilisation du tampon de résumé de conversation dans une chaîne

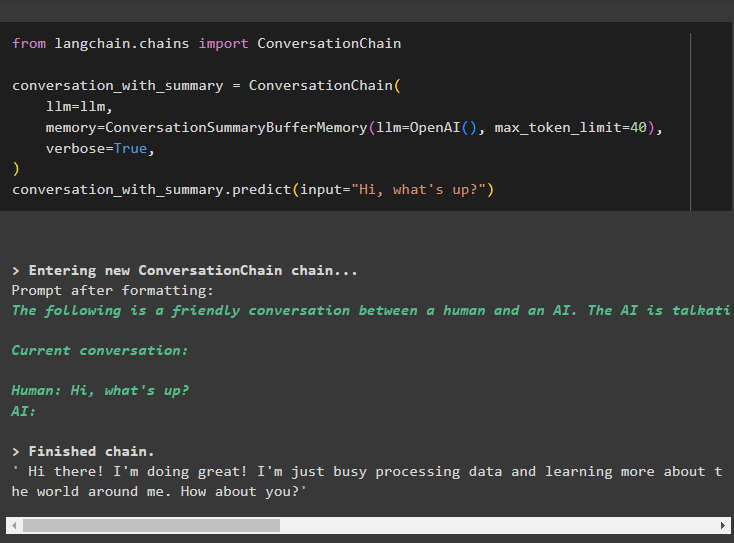

Construisez les chaînes en utilisant le Chaîne de conversation() méthode contenant la valeur de la mémoire tampon pour y stocker le message :

depuis chaîne de langue. Chaînes importer Chaîne de conversationsconversation_avec_summary = Chaîne de conversations (

llm = llm ,

mémoire = ConversationRésuméBufferMémoire ( llm = OpenAI ( ) , max_token_limit = 40 ) ,

verbeux = Vrai ,

)

conversation_avec_summary. prédire ( saisir = 'Salut, ça va?' )

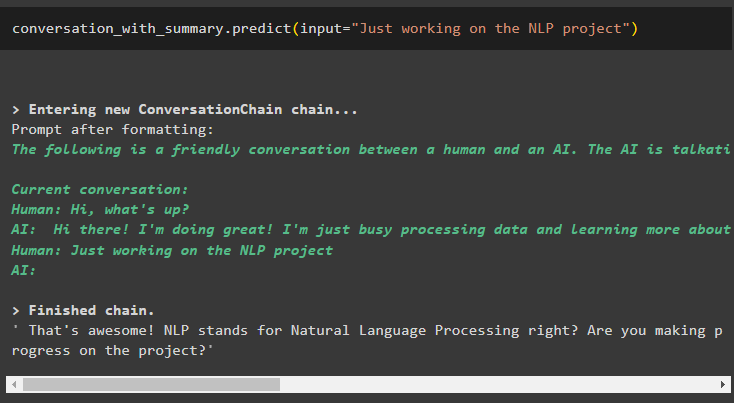

Fournissez l'entrée sous forme de texte à l'aide de la méthode prédiction() pour obtenir le résumé de la conversation :

conversation_avec_summary. prédire ( saisir = 'Je travaille juste sur le projet NLP' )

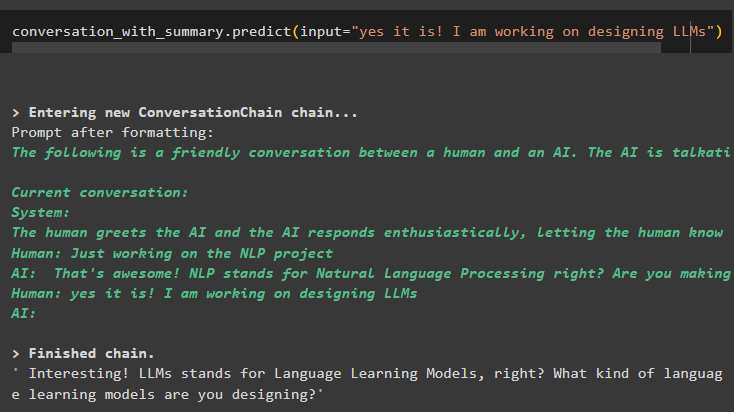

Utilisez la sortie du modèle et ajoutez plus de données à l'aide des messages dans la mémoire tampon et affichez son résumé :

conversation_avec_summary. prédire ( saisir = 'Oui, c'est vrai ! Je travaille sur la conception de LLM' )

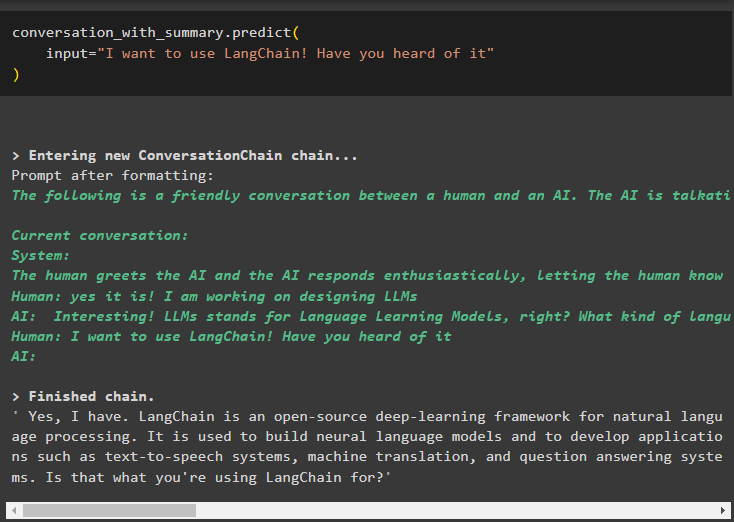

Le résumé est que le résultat sera facilement compréhensible, plus convivial et plus adapté aux chatbots :

conversation_avec_summary. prédire (saisir = 'Je veux utiliser LangChain ! En avez-vous entendu parler'

)

Il s’agit d’utiliser le tampon de résumé de conversation dans LangChain.

Conclusion

Pour utiliser la mémoire tampon de résumé de conversation dans LangChain, installez simplement les modules ou frameworks pour obtenir les bibliothèques requises. Une fois les bibliothèques importées, créez les LLM ou chatbots pour utiliser la fonction ConverstaionSummaryBufferMemory() pour obtenir le résumé de la conversation. La mémoire tampon permet de limiter le nombre de messages stockés en mémoire à utiliser pour extraire le résumé. Cet article a expliqué le processus d'utilisation de la mémoire tampon de résumé de conversation dans LangChain.