Comment utiliser une fenêtre tampon de conversation dans LangChain ?

La fenêtre tampon de conversation est utilisée pour conserver les messages les plus récents de la conversation en mémoire afin d'obtenir le contexte le plus récent. Il utilise la valeur du K pour stocker les messages ou les chaînes dans la mémoire à l'aide du framework LangChain.

Pour apprendre le processus d'utilisation de la fenêtre tampon de conversation dans LangChain, parcourez simplement le guide suivant :

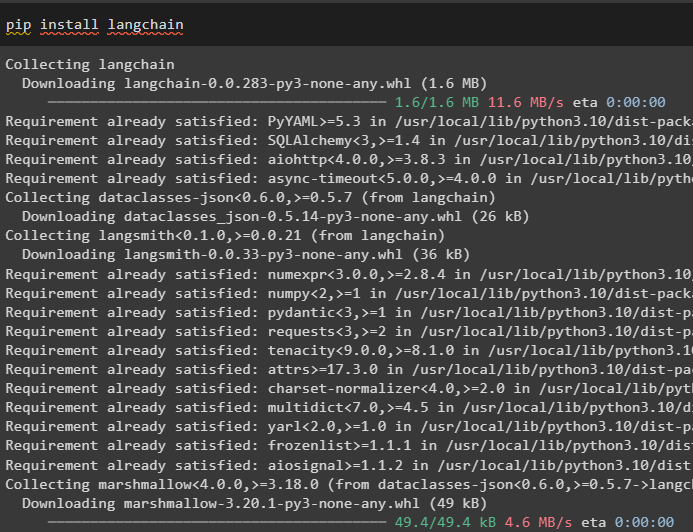

Étape 1 : Installer les modules

Démarrez le processus d'utilisation de la fenêtre tampon de conversation en installant le module LangChain avec les dépendances requises pour créer des modèles de conversation :

pip installer langchain

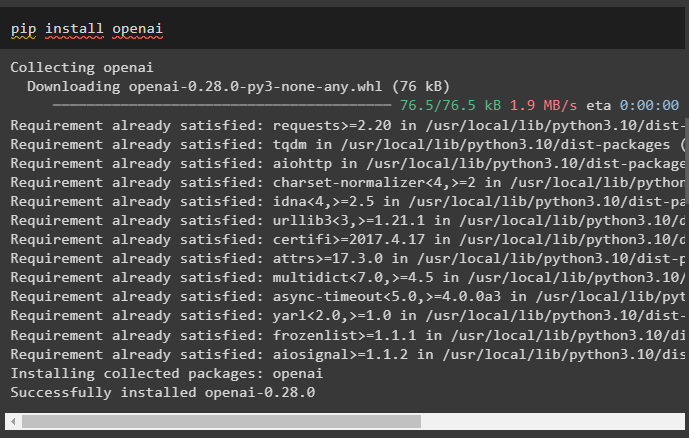

Après cela, installez le module OpenAI qui peut être utilisé pour créer les grands modèles de langage dans LangChain :

pip installer openai

Maintenant, configurer l'environnement OpenAI pour construire les chaînes LLM à l'aide de la clé API du compte OpenAI :

importer toi

importer obtenir un laissez-passer

toi . environ [ 'OPENAI_API_KEY' ] = obtenir un laissez-passer . obtenir un laissez-passer ( « Clé API OpenAI : » )

Étape 2 : Utilisation de la mémoire de la fenêtre du tampon de conversation

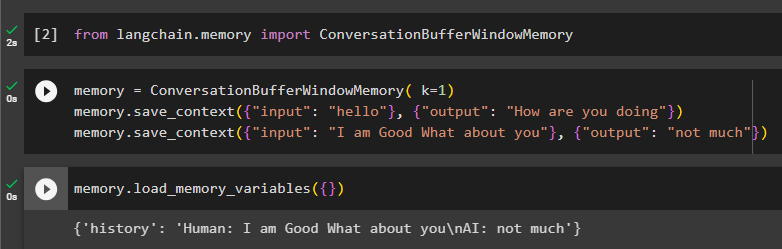

Pour utiliser la mémoire de la fenêtre tampon de conversation dans LangChain, importez le ConversationBufferWindowMémoire bibliothèque:

depuis chaîne de langage. mémoire importer ConversationBufferWindowMémoireConfigurez la mémoire à l'aide du ConversationBufferWindowMémoire () avec la valeur de k comme argument. La valeur du k sera utilisée pour conserver les messages les plus récents de la conversation puis configurer les données d'entraînement à l'aide des variables d'entrée et de sortie :

mémoire = ConversationBufferWindowMémoire ( k = 1 )mémoire. sauvegarder_contexte ( { 'saisir' : 'Bonjour' } , { 'sortir' : 'Comment allez-vous' } )

mémoire. sauvegarder_contexte ( { 'saisir' : 'Je suis bon et toi' } , { 'sortir' : 'pas beaucoup' } )

Testez la mémoire en appelant le load_memory_variables () méthode pour démarrer la conversation :

mémoire. load_memory_variables ( { } )

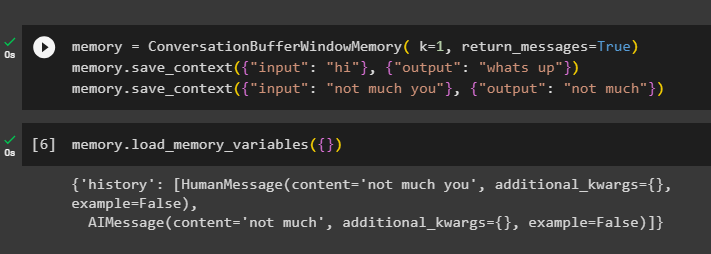

Pour obtenir l'historique de la conversation, configurez la fonction ConversationBufferWindowMemory() à l'aide du return_messages argument:

mémoire = ConversationBufferWindowMémoire ( k = 1 , return_messages = Vrai )mémoire. sauvegarder_contexte ( { 'saisir' : 'Salut' } , { 'sortir' : 'quoi de neuf' } )

mémoire. sauvegarder_contexte ( { 'saisir' : 'pas grand-chose pour toi' } , { 'sortir' : 'pas beaucoup' } )

Maintenant, appelez la mémoire en utilisant le load_memory_variables () pour obtenir la réponse avec l'historique de la conversation :

mémoire. load_memory_variables ( { } )

Étape 3 : Utilisation de la fenêtre tampon dans une chaîne

Construisez la chaîne en utilisant le OpenAI et Chaîne de conversations bibliothèques puis configurez la mémoire tampon pour stocker les messages les plus récents de la conversation :

depuis chaîne de langue. Chaînes importer Chaîne de conversationsdepuis chaîne de langue. llms importer OpenAI

#construction d'un résumé de la conversation en utilisant plusieurs paramètres

conversation_avec_summary = Chaîne de conversations (

llm = OpenAI ( température = 0 ) ,

#création d'un tampon mémoire en utilisant sa fonction avec la valeur k pour stocker les messages récents

mémoire = ConversationBufferWindowMémoire ( k = 2 ) ,

#configure la variable verbeuse pour obtenir une sortie plus lisible

verbeux = Vrai

)

conversation_avec_summary. prédire ( saisir = 'Salut, ça va' )

Poursuivez maintenant la conversation en posant la question relative au résultat fourni par le modèle :

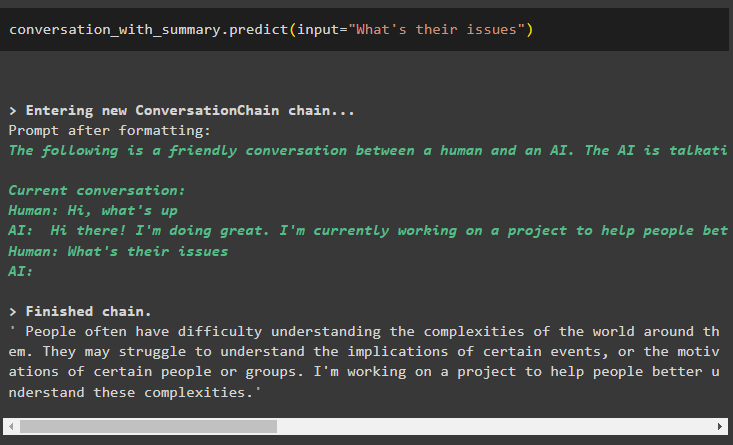

conversation_avec_summary. prédire ( saisir = 'Quels sont leurs problèmes' )

Le modèle est configuré pour stocker un seul message précédent qui peut être utilisé comme contexte :

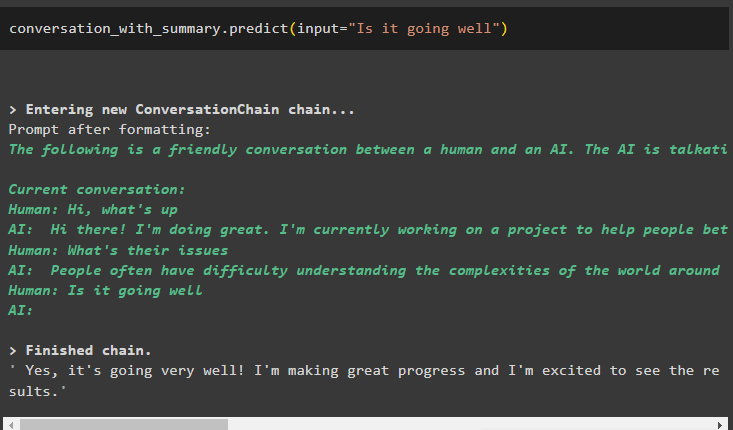

conversation_avec_summary. prédire ( saisir = 'Est-ce que ça va bien' )

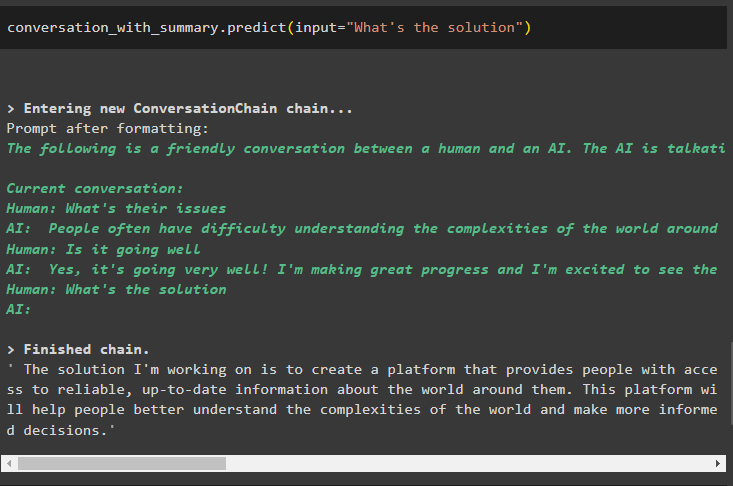

Demandez la solution aux problèmes et la structure de sortie continuera à faire glisser la fenêtre tampon en supprimant les messages précédents :

conversation_avec_summary. prédire ( saisir = 'Quelle est la solution' )

Il s’agit du processus d’utilisation des fenêtres du tampon de conversation LangChain.

Conclusion

Pour utiliser la mémoire de la fenêtre tampon de conversation dans LangChain, installez simplement les modules et configurez l'environnement à l'aide de la clé API d'OpenAI. Après cela, construisez la mémoire tampon en utilisant la valeur de k pour conserver les messages les plus récents de la conversation afin de conserver le contexte. La mémoire tampon peut également être utilisée avec des chaînes pour lancer la conversation avec le LLM ou la chaîne. Ce guide a expliqué le processus d'utilisation de la fenêtre tampon de conversation dans LangChain.